栏目分类

微软AI数据中心提前上线 数十万Blackwell GPU集结成超级集群

发布日期:2026-04-29 03:31 点击次数:97

微软Fairwater AI数据中心已提前投入运行,这一全球最强大的AI设施将数百台GB200 GPU基于Blackwell架构集成为单一无缝集群,标志着AI基础设施迈入全新规模。

图:微软Fairwater AI数据中心鸟瞰图,展现其庞大厂房与冷却系统布局

工程设计亮点:闭环液冷与全球级光纤互联

Fairwater项目从规划到落地,核心在于工程层面的极致优化。整个集群通过海量光纤互联——长度足以环绕地球4.5圈——将所有GPU打造成一个统一系统,避免传统数据中心常见的碎片化瓶颈。这种“单集群”架构让每台机架如同一个巨型加速器,内部带宽高达1.8TB/s,GPU间内存池化达14TB,直接提升AI训练的并行效率。

图:NVIDIA GB200 NVL72机架实拍,Blackwell架构高密度部署示例

冷却系统同样体现人性化与可持续设计:采用闭环液冷方案,建设完成后无需额外消耗水资源,同时搭配可再生能源供电,包括新建的250MW太阳能电站。这不仅降低了能耗压力,还确保周边生态不受影响,真正将大规模算力与环保需求平衡起来。

Blackwell架构性能突破:从机架到超级计算机的跃升

Blackwell GPU的部署并非简单堆叠硬件,而是通过NVLink等技术实现每机架72颗GPU的深度融合。微软数据显示,这种设计能将 token 处理速度推至每秒86.5万次,远超当前主流云平台。项目提前上线,也反映出供应链与工程团队在高压下高效协同的能力——从2025年9月宣布到2026年4月投运,仅用半年多时间就完成关键节点,展现了AI基础设施建设的速度新标杆。

DeepSeek V4创新路径:华为芯片驱动的效率优化

与此同时,AI模型端也在快速演进。DeepSeek V4即将发布,据报道可能全面采用华为Ascend芯片完成训练与推理,这标志着部分前沿模型开始探索脱离传统主流硬件的路径。

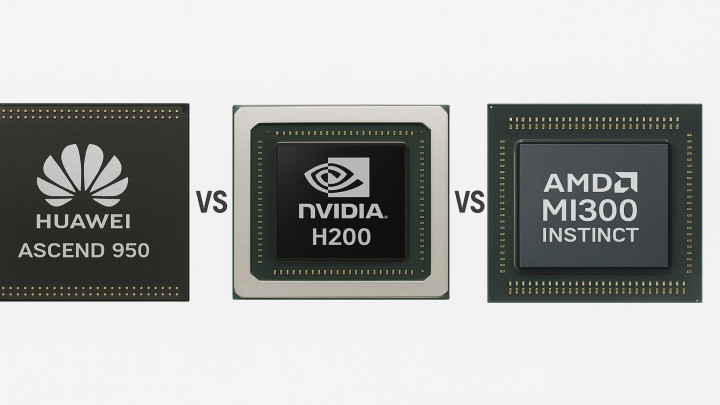

图:华为Ascend系列AI芯片与其他主流产品对比示意

不同于单纯追求单芯片算力,DeepSeek团队借助Mixture-of-Experts(MoE)等软件技术,通过更多芯片协同与算法优化,实现高效能利用。这种“规模+效率”策略,充分利用了充足的人才储备与能源条件,为AI开发提供了另一条可行路线。

行业趋势洞察:算力规模与软件效率的平衡竞争

当前AI基础设施正处于快速迭代期。微软式超大规模集群代表了硬件密集型路线,通过液冷、高速互联和可再生能源,解决训练前沿模型所需的极端算力需求;而DeepSeek V4的探索则凸显软件与生态的重要性——即使硬件存在代际差距,通过架构创新与协同优化,仍能交付实用性能。这两种路径的并存,正推动整个产业向更高效、更可持续的方向发展。

图:AI数据中心液冷系统内部布局,突出高密度散热设计

市场层面看,全球AI算力需求持续激增,但电力、供应链与环境约束也日益突出。未来,数据中心设计将更加注重“全栈”整合:从芯片到冷却、再到能源管理,都需提前规划。NVIDIA Blackwell的广泛部署进一步巩固了高性能生态,而新兴优化路径则为产业多元化注入活力,最终受益的是开发者与终端用户——AI模型训练周期缩短,推理成本下降,应用落地速度加快。

这一切表明,AI基础设施的演进正进入注重规模、效率与可持续性的务实阶段。无论是提前上线的Fairwater集群,还是持续突破的模型创新,都在为下一代智能技术铺路,让前沿计算能力更稳健地服务于实际需求。